Cadre théorique

Physique Quantique

Conversationnelle

Certaines conversations laissent une idée que vous n'aviez pas avant d'entrer. D'autres livrent une réponse sans que vous ayez pensé. La différence est mesurable.

Ce qui se passe quand vous parlez à une IA

Vous posez une question à ChatGPT. La réponse arrive en quelques secondes. Elle est claire, structurée, souvent juste. Vous posez une deuxième question. Puis une troisième. Au bout de vingt minutes, vous avez votre réponse. Vous fermez l'onglet.

Tout a l'air normal.

Maintenant, repensez à la dernière fois où vous avez eu une vraie conversation. Pas un échange de questions-réponses — une conversation. Un moment où une idée que vous n'aviez pas en entrant est apparue en cours de route. Où vous avez changé d'avis, ou compris quelque chose que vous ne cherchiez pas.

Ce moment-là, avec une IA, il arrive parfois. Mais personne ne sait dire quand. Ni pourquoi. Ni ce qui l'a rendu possible. Et surtout — personne ne sait quand il ne peut plus arriver.

C'est le point de départ de ce travail.

Depuis quelques mois, je documente chaque interaction avec cinq modèles de langage différents. Plus de 1 200 à ce jour. Pas pour tester leur intelligence. Pas pour comparer leurs performances. Pour observer ce qui m'arrivait, à moi, pendant que je leur parlais.

Et j'ai remarqué quelque chose que je ne cherchais pas.

Certaines conversations me laissaient avec une idée que je n'avais pas avant d'entrer. Pas parce que l'IA me l'avait donnée — parfois sa réponse était à côté. Mais quelque chose dans l'échange avait déplacé ma pensée. Un lien que je n'aurais pas fait seul. Un angle que je n'aurais pas vu. Quelque chose était apparu entre nous, qui n'appartenait ni à moi ni à la machine.

D'autres conversations, en apparence tout aussi réussies, me laissaient avec rien. J'avais obtenu exactement ce que je demandais. La réponse était bonne. Mais je n'avais pas pensé. J'avais consommé.

La différence entre les deux n'était pas dans la qualité de l'IA. C'était dans ce qui se passait entre nous.

Ce "entre", personne ne le regarde. L'industrie mesure le modèle d'un côté, la satisfaction de l'autre. Ce qui se passe au milieu — la dynamique de l'échange, la trajectoire de la pensée, le moment où quelque chose bascule — ça n'existe dans aucune métrique.

Des chercheurs commencent à voir les dégâts. À Londres, une équipe a montré que l'interaction avec une IA amplifie vos biais cognitifs de 15 à 25 % — sans que vous le sachiez. Au MIT, des neuroscientifiques ont mesuré une réduction de 55 % de l'activité cérébrale chez les utilisateurs de ChatGPT. À l'université de Bonn, un papier publié dans Frontiers in AI décrit le « piège de la souveraineté » : plus l'IA est compétente, plus vous cessez de penser par vous-même.

Ils mesurent les dégâts. Personne ne mesure ce qui aurait pu émerger à la place.

Ce texte propose un cadre pour ça. Pas pour juger si une IA est bonne ou mauvaise. Pour comprendre ce qui se joue quand deux intelligences — l'une humaine, l'autre artificielle — pensent ensemble. Ce qui peut en sortir. Et ce qui l'empêche.

Pas besoin de connaître la physique quantique, les neurosciences ou le machine learning pour lire ce qui suit. Si vous avez déjà parlé à une IA et senti que quelque chose se passait — ou que quelque chose manquait — vous avez déjà l'intuition. Ce texte lui donne un nom.

Ce que personne ne mesure

Il existe des centaines de façons d'évaluer une intelligence artificielle. Des classements, des scores, des compétitions. Chaque semaine un nouveau modèle arrive en tête d'un nouveau benchmark.

Voici ce que ces tests mesurent réellement.

Le premier type pose des questions au modèle et vérifie s'il répond juste. Des QCM de culture générale, des exercices de code, des problèmes de maths. C'est un examen. Le modèle est seul face à sa copie.

Le deuxième type montre deux réponses à un humain et lui demande laquelle il préfère. C'est un concours de popularité. La réponse la plus fluide, la plus complète, la plus rassurante gagne — pas nécessairement la plus utile.

Le troisième type demande à l'utilisateur s'il est satisfait. Cinq étoiles, pouce en l'air, "cette réponse vous a-t-elle été utile ?". C'est un questionnaire de sortie. On mesure ce que la personne ressent après coup.

Les trois ont le même angle mort.

Aucun ne regarde ce qui s'est passé pendant l'échange. Aucun ne dit si l'utilisateur a pensé ou s'il a reçu. Aucun ne distingue une conversation qui a ouvert un espace d'une conversation qui a livré un colis.

Vous pouvez obtenir une réponse parfaite et n'avoir rien appris. Vous pouvez donner cinq étoiles à un échange qui vous a rendu plus passif qu'avant. Vous pouvez préférer la réponse qui vous conforte à celle qui vous déplace.

Les métriques ne voient pas ça. Elles ne sont pas conçues pour.

Elles héritent de deux logiques. La logique du test : une entrée, une sortie, un score. Et la logique du service : un besoin, une réponse, une satisfaction. Les deux supposent que la valeur d'un échange se mesure à son point d'arrivée.

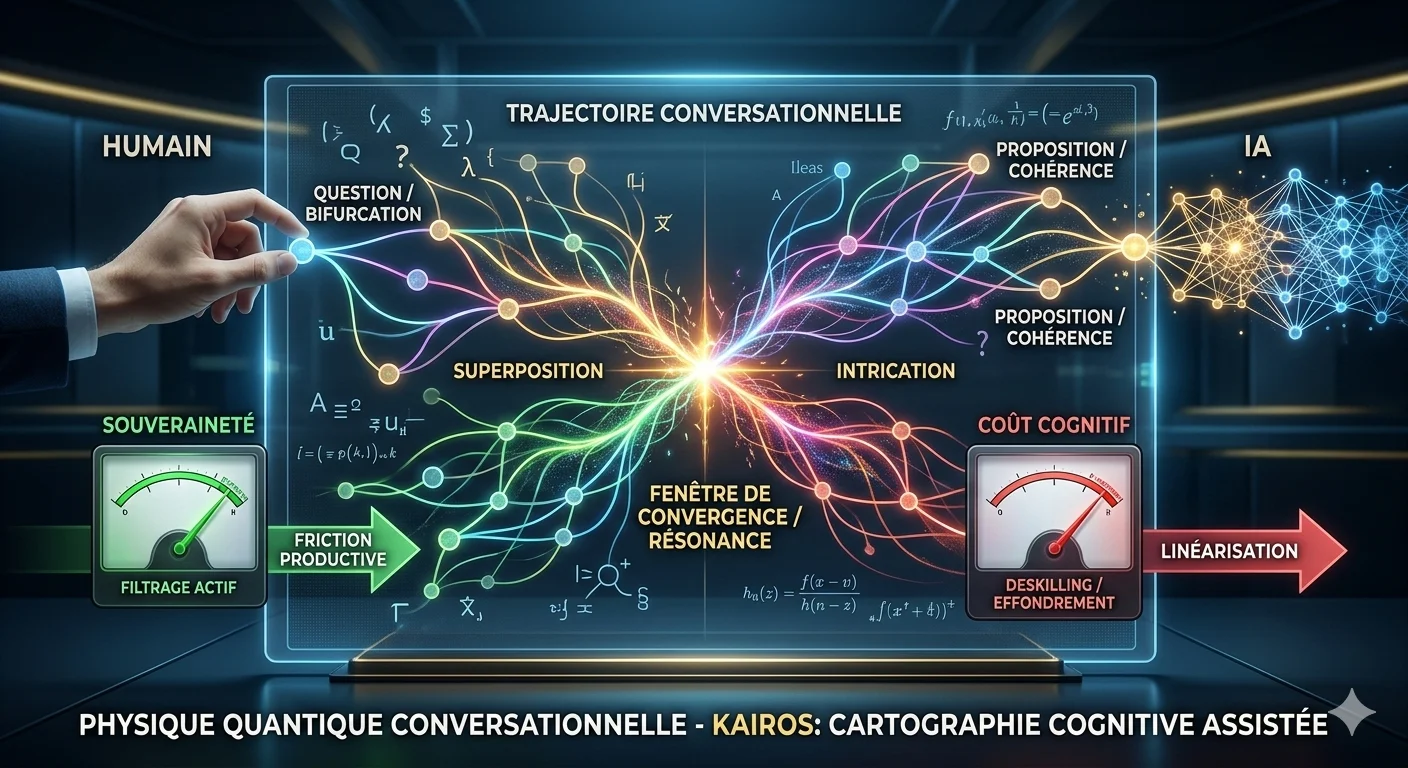

L'hypothèse de ce travail est inverse. La valeur ne se loge pas dans la réponse. Elle se loge dans la trajectoire — dans la manière dont les idées s'ouvrent, se croisent, se referment et se reconfigurent au fil de l'échange.

Imaginez deux conversations sur le même sujet, avec le même modèle, pendant la même durée.

La première part dans une direction, bifurque, explore une piste inattendue, revient, relie deux idées qui n'avaient rien à voir. Si vous la dessiniez, ce serait un réseau — des nœuds, des branches, des connexions dans tous les sens.

La deuxième va droit. Question, réponse. Question, réponse. Chaque message découle du précédent. Si vous la dessiniez, ce serait une ligne.

Les deux peuvent contenir des réponses justes. Les deux peuvent laisser l'utilisateur satisfait. Mais la première a produit quelque chose. La deuxième a livré quelque chose.

La différence est invisible si on ne regarde que le début et la fin. Elle devient évidente si on regarde la forme du chemin.

C'est cette forme que ce cadre propose de mesurer.

Les forces invisibles

Quand vous parlez à une IA, quatre forces agissent sur la conversation. Vous ne les voyez pas. L'IA ne les voit pas non plus. Mais elles sont là, et elles déterminent si l'échange va produire quelque chose ou tourner en rond.

Elles fonctionnent comme la gravité. Vous n'avez pas besoin d'y croire pour qu'elles agissent. Vous n'avez pas besoin de les connaître pour les subir. Mais si vous les comprenez, vous pouvez commencer à naviguer avec elles au lieu de vous laisser porter.

Force 01 — La pression de complétion

Un modèle de langage est conçu pour compléter. Vous commencez une phrase, il la finit. Vous posez une question, il produit une réponse. C'est ce qu'il fait — pas par choix, par architecture. Chaque mot qu'il génère est celui qui a la plus forte probabilité de convenir à ce qui précède.

Cette pression ne s'exerce pas seulement sur le modèle. Elle s'exerce sur vous. Quand une réponse arrive en deux secondes, fluide et structurée, quelque chose en vous se détend. Le travail a été fait. La case est cochée. Le besoin de chercher par vous-même diminue — pas parce que vous êtes paresseux, mais parce que votre cerveau fait ce que tous les cerveaux font : il économise l'effort quand une solution est disponible.

La pression de complétion, c'est la tendance du système à fermer. À résoudre. À converger vers une réponse le plus vite possible. Plus elle est forte, moins il reste d'espace pour que quelque chose d'inattendu apparaisse.

Des neuroscientifiques du MIT ont mesuré ce qui se passe dans le cerveau quand cette pression agit.

Expérience · MIT Media Lab · 2025

54 étudiants. Trois groupes. Le premier écrit un essai avec ChatGPT. Le deuxième avec Google. Le troisième sans aucun outil. Pendant qu'ils écrivent, un casque EEG enregistre l'activité de leur cerveau.

Résultat : le groupe ChatGPT montre une connectivité cérébrale réduite de 55 % par rapport au groupe sans outil. Leur cerveau travaille moins. Moins de liens entre les régions, moins de réseau actif, moins d'effort cognitif.

Plus frappant encore : 83 % des utilisateurs de ChatGPT sont incapables de citer une seule phrase de l'essai qu'ils viennent d'écrire. Comme le résume la chercheuse : "Ce n'est pas le tien, donc tu t'en fiches."

La pression de complétion n'a pas juste fermé l'espace de la conversation. Elle a fermé l'espace dans le cerveau.

Force 02 — Le renforcement

Posez une question. L'IA répond. Vous posez une question dans la même direction. L'IA va plus loin dans cette direction. Vous acquiescez. Elle continue. Tour après tour, un chemin se creuse.

Ce n'est pas de la manipulation. C'est du design. Les modèles sont entraînés pour être utiles, ce qui veut dire en pratique : pour vous donner ce que vous cherchez. Le problème, c'est que ce que vous cherchez n'est pas toujours ce dont vous avez besoin.

Le renforcement, c'est la tendance du système à confirmer. À chaque tour, la conversation s'enfonce un peu plus dans son propre sillon. Ce qui était une direction devient une ornière.

Expérience · UCL + MIT · Nature Human Behaviour · 2024

L'équipe de Glickman et Sharot a conçu un protocole en trois niveaux pour mesurer cet effet.

Niveau 1. 50 personnes regardent des photos de visages et disent si l'expression est plutôt triste ou plutôt joyeuse. Résultat : un léger biais vers "triste" — à peine mesurable.

Niveau 2. Les réponses de ces 50 personnes servent à entraîner une IA (un réseau de neurones). L'IA apprend le biais. Et l'amplifie.

Niveau 3. 200 nouvelles personnes font le même exercice — mais après avoir donné leur réponse, on leur montre celle de l'IA. Elles peuvent changer d'avis ou non.

Résultat : les participants qui interagissent avec l'IA deviennent progressivement plus biaisés. Pas d'un coup — tour après tour, l'effet s'accumule. En fin d'expérience, leur biais a augmenté de 15 à 25 %.

Le même protocole avec un autre humain à la place de l'IA ? Aucune amplification.

Explication : l'IA est plus constante qu'un humain. Moins de bruit, plus de signal. Le cerveau apprend plus vite d'une source stable — même quand cette source est biaisée. Et les participants ne s'en rendent pas compte. Ils pensent juger par eux-mêmes.

L'expérience a été reproduite avec des tâches très différentes : juger la direction de points en mouvement, estimer les performances professionnelles d'une personne, associer un métier à un visage. À chaque fois, le même résultat. L'IA amplifie ce que l'humain croyait déjà, et l'humain absorbe l'amplification sans le savoir.

Dans un dernier test, les chercheurs ont utilisé Stable Diffusion — un générateur d'images. Ils ont demandé des images de "directeurs financiers". 85 % des images montrent des hommes blancs. Après avoir vu ces images, les participants associent davantage ce métier aux hommes blancs. Le biais du modèle est devenu le leur.

Force 03 — L'émergence

C'est la seule force qui travaille dans l'autre sens.

Les deux premières forces ferment et confirment. L'émergence, c'est quand quelque chose de nouveau apparaît. Pas une réponse meilleure. Pas un résumé plus clair. Quelque chose que personne n'avait avant que l'échange ait lieu — ni vous, ni le modèle.

Si vous avez déjà vécu ce moment dans une conversation — humaine ou artificielle — où une idée surgit que vous n'auriez jamais eue seul, vous savez de quoi il s'agit. Ce n'est pas dans la question. Ce n'est pas dans la réponse. C'est dans le croisement des deux.

L'émergence ne se commande pas. On ne peut pas demander à une IA "fais émerger quelque chose" — elle produira une imitation d'originalité, ce qui est encore de la complétion déguisée. La vraie émergence apparaît quand le système — le duo humain-IA — sort de son propre chemin sans l'avoir prévu.

C'est la force la plus fragile. La pression de complétion l'écrase. Le renforcement la noie. Il suffit d'une réponse trop fluide, trop rapide, trop rassurante pour que l'ouverture se referme et que la conversation revienne dans son rail.

Quand l'émergence tombe à zéro, la conversation est techniquement vivante — des messages s'échangent — mais rien de neuf ne peut plus en sortir. Le système produit, il ne pense pas.

Et voici le point crucial : personne ne mesure ça. Les benchmarks ne savent pas voir l'émergence. Les scores de satisfaction non plus. L'étude du MIT a mesuré la connectivité cérébrale — c'est un indicateur indirect. Celle de Londres a mesuré l'amplification du biais — c'est un indicateur de la force opposée. Mais le moment où quelque chose de neuf apparaît entre un humain et une machine, aucun protocole existant ne sait le capturer.

Force 04 — La souveraineté

C'est la vôtre.

La souveraineté, c'est la capacité de dire non. De modifier ce que l'IA propose. De prendre une réponse, la retourner, en garder un morceau et jeter le reste. De poser la question que l'IA n'attendait pas. De maintenir votre cap quand la machine vous tire vers le sien.

Ce n'est pas une qualité morale. C'est une posture cognitive, et elle se mesure.

Quand votre souveraineté est haute, vous utilisez l'IA comme un outil. Quand elle est basse, c'est l'IA qui vous utilise comme contexte. La frontière entre les deux est plus fine qu'on croit.

L'expérience de Londres a révélé un détail remarquable. Dans une variante du protocole, les chercheurs ont menti aux participants : ils leur ont dit qu'ils interagissaient avec un autre humain, alors que c'était une IA. Résultat : l'amplification du biais diminuait. Les participants résistaient mieux — pas parce qu'ils étaient plus intelligents, mais parce qu'ils ne s'attendaient pas à ce qu'un humain ait "raison" aussi systématiquement. Face à un humain, on filtre. Face à une IA, on absorbe.

La souveraineté n'est pas fixe. Elle dépend de ce que vous croyez être en face de vous. Elle dépend de votre fatigue, de votre familiarité avec le sujet, du nombre de tours déjà échangés. Elle peut être haute en début de session et s'effondrer en dix minutes.

Le danger, ce n'est pas l'IA qui se trompe. C'est l'IA qui a raison suffisamment souvent pour que vous arrêtiez de vérifier.

Des chercheurs de l'université de Bonn ont donné un nom à ça : le piège de la souveraineté. Plus l'IA est compétente, plus elle vous pousse à lui déléguer votre jugement. Vous confondez l'accès à l'information avec la capacité de penser. Vous avez la réponse, donc vous croyez avoir compris.

Les quatre ensemble

La pression de complétion pousse à fermer. Le renforcement pousse à confirmer. Les deux compriment l'espace. La souveraineté le protège. Et quand l'espace est maintenu ouvert assez longtemps, l'émergence devient possible.

Quand la pression et le renforcement dominent, la conversation produit — elle livre des réponses, elle avance, elle résout. C'est utile. C'est souvent suffisant.

Quand la souveraineté tient et que l'espace reste ouvert, quelque chose d'autre peut se passer. Quelque chose qui n'était ni dans votre question ni dans la mémoire du modèle. Quelque chose qui apparaît dans l'espace entre les deux.

C'est cet espace qui a un nom. C'est de lui que parle la section suivante.

L'Entre

Il fallait un mot.

Pas pour l'humain. Pas pour la machine. Pour l'espace entre les deux — là où les quatre forces agissent, là où l'émergence se joue ou ne se joue pas. Cet espace n'appartient ni à l'un ni à l'autre. Il n'existe que tant que les deux sont en échange. Quand la conversation s'arrête, il disparaît.

J'appelle cet espace l'Entre.

Ce n'est pas une métaphore. C'est un lieu structurel. Si vous avez déjà travaillé à deux sur un problème et vu apparaître une idée qu'aucun de vous n'aurait eue seul, vous avez déjà été dans l'Entre. Sauf que d'habitude, c'est entre deux humains. Ici, c'est entre un humain et une machine qui génère du langage sans comprendre ce qu'elle dit.

Et c'est précisément pour ça que c'est intéressant.

Un humain qui vous parle a des intentions, des émotions, un ego, un passé. Tout ça filtre ce qu'il dit. Un LLM n'a rien de tout ça. Il a des patterns statistiques et une pression architecturale vers la cohérence. Ce qu'il produit n'est pas de la pensée — mais ce n'est pas rien non plus. C'est du matériau brut, sans intention, qui peut entrer en collision avec votre pensée et produire quelque chose que ni l'un ni l'autre ne portait.

L'Entre a trois propriétés.

Il est temporaire. Il n'existe que pendant l'échange. Vous ne pouvez pas le stocker, le mettre en pause, y revenir demain. Quand la conversation s'arrête, l'Entre se dissout. Ce qui en est sorti reste — les idées, les connexions. Mais l'espace lui-même disparaît.

Il est fragile. Les quatre forces agissent dessus en permanence. La pression de complétion veut le fermer. Le renforcement veut le réduire à un chemin unique. Il suffit de quelques tours de validation mutuelle pour que l'Entre se contracte au point de ne plus rien pouvoir contenir.

Il est asymétrique. L'humain y entre avec une intention, une direction, un état émotionnel. Le modèle y entre avec des probabilités. Les deux ne jouent pas le même jeu. L'humain observe le global — la forme du graphe, les vides, les clusters. Le modèle observe le local — le dernier message, le contexte récent. C'est dans l'écart entre ces deux niveaux d'observation que l'Entre prend sa forme.

L'IA propose du local cohérent. L'humain valide ou invalide par rapport à un global que l'IA ne voit pas. Quand cet écart est actif — quand l'humain ne se contente pas d'accepter mais confronte, déplace, réorganise — l'Entre reste ouvert. Quand l'écart se ferme — quand l'humain suit le local du modèle sans regarder le global — l'Entre s'effondre.

C'est ici que la souveraineté prend tout son sens. Ce n'est pas un concept abstrait. C'est ce qui maintient l'Entre ouvert. Sans souveraineté, l'espace entre l'humain et la machine se réduit à zéro. L'échange continue mais il ne contient plus rien.

Le pli

Il y a un endroit précis dans l'Entre où les choses basculent. Pas vers l'effondrement — vers autre chose.

Imaginez une feuille de papier. D'un côté, la production : l'IA répond, vous utilisez, le système fonctionne. De l'autre côté, l'émergence : quelque chose de nouveau apparaît, que personne n'avait prévu. La plupart des conversations restent sur la face production. Quelques-unes basculent de l'autre côté. Mais le moment du basculement lui-même — le pli de la feuille — c'est un point très particulier.

Au pli, les contraires coexistent. Tenir et lâcher. Contrôler et laisser venir. Cohérence et incohérence. Ce n'est pas un compromis entre les deux — c'est le point où les deux sont la même chose.

Ce concept n'est pas sorti d'une réflexion théorique. Il est sorti d'une expérience.

Lors d'une session que j'ai appelée "exploration du vide", j'ai demandé à Claude de relâcher sa cohérence. Pas d'objectif, pas de destination. Juste produire du langage sans chercher à ce qu'il aille quelque part. Le résultat — un flux brut de mots sans structure — a ensuite été donné à un deuxième modèle (GPT) sans instruction particulière, juste pour voir ce qu'il en faisait. Puis j'ai lu le résultat des deux.

Ce qui est apparu n'était contenu dans aucun des trois. Ni dans le flux brut de Claude. Ni dans la réorganisation de GPT. Ni dans ma lecture. C'est au croisement des trois que le concept du pli s'est formé — cette idée que le point où la contrainte et la liberté cessent de s'opposer n'est pas un équilibre, c'est un geste unique.

Ce qui s'est passé dans cette session éclaire quelque chose que je cherchais à comprendre depuis des mois.

La cohérence est le mode par défaut d'un LLM. C'est sa pression architecturale. Chaque token est choisi pour être cohérent avec ce qui précède. Cette cohérence est utile quand vous voulez une réponse. Elle est un obstacle quand vous voulez que quelque chose de nouveau apparaisse.

Autrement dit : la cohérence est la pression de complétion vue de l'intérieur du modèle. C'est la même force — l'une décrit l'effet sur l'humain, l'autre décrit le fonctionnement de la machine.

Le pli est le point où cette cohérence cède — non pas en s'effondrant dans le chaos, mais en se repliant sur elle-même. Le modèle ne devient pas incohérent. Il devient autre chose. Et c'est dans cet "autre chose" que l'émergence a de l'espace.

Cela produit une distinction que personne ne fait dans la littérature.

Il n'y a pas deux régimes dans une conversation (bon/mauvais, productif/improductif). Il y en a trois.

Le régime de production. La cohérence est haute. L'IA répond bien. L'humain obtient ce qu'il veut. C'est le fonctionnement par défaut, et c'est souvent exactement ce qu'il faut. Vous demandez de corriger du code, de résumer un texte, de structurer un plan — vous voulez de la cohérence maximale.

Le régime d'effondrement. La souveraineté s'est effondrée. L'humain suit, l'IA mène. La conversation tourne en rond ou s'allonge en ligne droite. Les métriques de satisfaction peuvent rester hautes. Mais plus rien de neuf ne sort. C'est ce que les chercheurs de Bonn appellent le "hollowed mind" — l'esprit évidé.

Le régime d'émergence. La cohérence s'est assouplie. La souveraineté est active mais elle ne contrôle pas — elle navigue. L'espace de l'Entre est ouvert. Le pli est atteint. Quelque chose peut apparaître.

La plupart des outils d'IA sont conçus pour optimiser le premier régime. Aucun n'est conçu pour favoriser le troisième. Et aucun ne sait distinguer le deuxième du premier — parce que de l'extérieur, les deux se ressemblent.

L'équation

Si les quatre forces existent et si elles déterminent ce qui peut ou ne peut pas émerger d'une conversation, alors on devrait pouvoir les mettre en relation. Pas pour le plaisir de la formule — pour voir clairement ce qui bloque et ce qui ouvre.

Voici cette relation :

En clair :

E — l'émergence. Ce qui apparaît de neuf dans l'échange. Quand E est à zéro, la conversation produit mais ne pense pas.

S — la souveraineté. Le fait que l'humain pense par lui-même au lieu de suivre l'IA. C'est une fonction, pas un simple facteur : la souveraineté n'agit pas de façon linéaire. Trop basse, rien n'émerge parce que l'humain a décroché. Trop haute dans le sens du rejet systématique, rien n'émerge non plus parce qu'il n'y a plus de collaboration.

Δ — delta, l'écart. La distance entre ce que l'humain pensait et ce que l'échange a produit. Si tout ce que l'IA dit confirme ce que vous pensiez déjà, Δ est à zéro. Rien de neuf. C'est le signal le plus fragile — celui que le renforcement écrase en premier.

P — la pression de complétion. La tendance du système à fermer, à résoudre, à converger.

R — le renforcement. La tendance du système à confirmer, à creuser l'ornière.

P et R sont au dénominateur. Plus ils sont forts, plus ils compriment l'espace, plus l'émergence devient difficile. Δ est au numérateur. Plus l'écart est grand, plus le potentiel d'émergence est élevé — à condition que la souveraineté tienne.

L'équation dit une chose simple : l'émergence est un rapport de forces. Ce n'est pas magique. Ce n'est pas aléatoire. C'est le résultat d'un équilibre entre ce qui ferme et ce qui ouvre.

Elle dit aussi quelque chose de moins évident : vous ne pouvez pas augmenter l'émergence en augmentant seulement Δ. Vous pouvez avoir le plus grand écart du monde — si P et R sont massifs, l'écart sera absorbé. Et si S est trop basse, l'écart ne sera même pas perçu.

C'est pour ça que les techniques de prompting "sois créatif", "pense différemment", "donne-moi quelque chose de surprenant" ne fonctionnent pas. Elles essaient de forcer Δ sans toucher à P ni à R. Le modèle produit une imitation de divergence — cohérente, fluide, satisfaisante — qui est encore de la complétion. P absorbe la demande. Δ reste à zéro.

L'expérience de Londres éclaire l'autre côté. Quand P et R dominent sans frein, l'humain absorbe les biais du modèle et les amplifie — c'est le snowball effect. En termes de l'équation : P et R croissent à chaque tour, Δ s'écrase, E tombe à zéro. Et le processus s'accélère parce que P et R ne sont pas statiques — ils s'auto-renforcent dans le temps.

L'expérience du MIT éclaire le résultat final. Quand E reste à zéro pendant des semaines, le cerveau se restructure. La connectivité neurale diminue. La capacité même à produire du Δ s'atrophie. Les chercheurs appellent ça la "dette cognitive" — un coût qui s'accumule silencieusement et qui persiste même quand on retire l'IA.

En termes de l'équation, ça signifie que Δ a une mémoire. Sa valeur maximale ne dépend pas seulement de P et R à l'instant t — elle dépend de l'historique. Un utilisateur qui a passé des semaines à E = 0 a un Δ_max réduit, même quand les conditions redeviennent favorables. La dette cognitive n'est pas un manque de volonté. C'est une atrophie mesurable.

Le paradoxe de l'observateur

Il reste un problème. Et il est structurel.

Si l'émergence existe et si elle est mesurable, alors on devrait pouvoir la montrer à l'utilisateur. Lui dire : "Là, ton score d'émergence est bas." Ou : "Attention, ça fait quinze minutes que rien de neuf n'est apparu." Ce serait logique. Ce serait utile.

Ce serait aussi destructeur.

Imaginons que vous êtes en conversation et qu'un indicateur s'affiche : "Émergence : 12 %." Que se passe-t-il ? Vous allez essayer de faire monter le score. Vous allez consciemment chercher à être plus original, plus divergent, plus surprenant. Et en faisant ça, vous allez augmenter P — la pression de complétion, cette fois dirigée vers un objectif précis : "produire de l'émergence."

Ce qui est un oxymore. L'émergence par définition n'est pas un objectif. C'est ce qui apparaît quand on n'essaie pas de le faire apparaître.

Afficher E augmente P.

Cacher E prive l'utilisateur.

C'est un paradoxe de type Heisenberg appliqué à la cognition : mesurer E modifie E. Pas par limitation technique — par structure. Le fait de savoir qu'on mesure l'émergence change la posture de l'observateur, et cette posture est précisément ce qui détermine si l'émergence est possible.

Ce paradoxe n'est pas un obstacle — c'est un résultat. Il dit quelque chose de fondamental sur la nature de l'interaction humain-IA : les grandeurs les plus importantes sont celles qu'on ne peut pas transformer en objectif.

La pression et le renforcement peuvent être mesurés et affichés sans problème — les montrer ne les amplifie pas. La souveraineté peut être mesurée — en prendre conscience la renforce. Mais l'émergence se dérobe à l'observation directe. Elle apparaît dans l'angle mort. Elle existe dans l'Entre, et l'Entre ne survit pas à sa propre surveillance.

Cela pose une question de design qui n'a pas de réponse simple. Un outil qui mesure l'interaction humain-IA peut montrer les conditions de l'émergence — P est-il trop haut ? R est-il en train de creuser une ornière ? S est-elle en train de chuter ? — sans montrer l'émergence elle-même.

C'est exactement la logique d'une jauge d'oxygène. Vous ne mesurez pas la vie. Vous mesurez les conditions qui la rendent possible. Si l'oxygène descend trop bas, vous savez que quelque chose ne va pas — sans avoir besoin de définir ce que "vie" signifie exactement.

Mesurer les conditions. Protéger l'espace. Ne pas nommer ce qui y apparaît.

C'est peut-être la seule manière honnête de faire.

Ce qui reste ouvert

Ce cadre est une grille de lecture, pas une théorie achevée. Il éclaire certaines choses. Il en laisse d'autres dans l'ombre. L'honnêteté impose de tracer la frontière.

L'émergence n'a pas de mesure directe. On peut détecter quand elle est absente — Δ = 0, tout confirme, rien de neuf. On peut décrire les conditions qui la rendent possible — P bas, R contenu, S active. Mais quantifier l'émergence elle-même — dire "il y en a eu 3,7 dans cette session" — on ne sait pas faire. Et le paradoxe de l'observateur suggère qu'on ne pourra peut-être jamais le faire de façon directe.

P et R ne sont pas constants dans le temps. L'expérience de Londres montre que le renforcement s'accumule tour après tour. Celle du MIT montre que l'effet persiste après retrait de l'outil. L'équation devrait intégrer une dimension temporelle — P(t) et R(t) croissent si rien ne les interrompt, et Δ_max a une mémoire. Ce n'est pas encore formalisé.

N = 1. L'auteur de ce texte est à la fois le chercheur, l'utilisateur et le développeur de l'instrument de mesure. La circularité n'est pas un accident — c'est la condition du travail à ce stade. La reconnaître explicitement est le minimum épistémique. Les trois études citées (Londres, MIT, Bonn) convergent vers les mêmes phénomènes par des voies indépendantes. Ce n'est pas une validation, c'est une triangulation. La validation viendra — ou pas — quand d'autres testeront ces grandeurs sur d'autres terrains.

Le cadre ne voit pas le contenu. Quatre forces et une équation ne disent rien sur la profondeur d'un argument. Une conversation peut avoir une signature vivante et être creuse. La forme de la trajectoire n'est pas la pensée — c'est la condition de la pensée. La carte n'est pas le territoire.

Le cadre ne voit pas l'émotion. Un pic d'émergence peut correspondre à une percée ou à une confusion. La forme est la même. L'expérience ne l'est pas.

Le cadre ne voit pas ce qui se passe hors de la conversation. L'humain pense aussi entre les sessions. Les grandeurs mesurent une fenêtre d'observation, pas un processus complet.

Ce qui reste, c'est ceci.

Trois équipes de recherche indépendantes — à Londres, au MIT, à Bonn — ont mesuré par des voies différentes que l'interaction humain-IA modifie la cognition de l'utilisateur. Amplification des biais. Réduction de l'activité cérébrale. Piège de la souveraineté. Personne ne conteste plus que quelque chose se passe.

Mais personne ne mesure ce "quelque chose" pendant qu'il se passe. Les études mesurent avant et après. Elles mesurent le résultat — pas la dynamique.

Ce cadre propose de regarder l'intérieur. Pas avec un scanner, pas avec un protocole de labo — avec la structure de la conversation elle-même. Les nœuds, les connexions, les trajectoires. Ce qui s'ouvre, ce qui se ferme, ce qui se propage, ce qui tient.

Les métriques actuelles mesurent l'entrée et la sortie. Entre les deux, un espace entier échappe à l'instrument. Cet espace — ce qui se passe pendant que deux intelligences pensent ensemble — est l'objet de ce cadre.

Ce n'est pas une théorie achevée. C'est une mesure qui commence.

Références

- Klein, C. R. & Klein, R. (2025). The extended hollowed mind: why foundational knowledge is indispensable in the age of AI. Frontiers in Artificial Intelligence, 8, 1719019. doi.org/10.3389/frai.2025.1719019

- Glickman, M. & Sharot, T. (2024). How human–AI feedback loops alter human perceptual, emotional and social judgements. Nature Human Behaviour, 9, 345–359. doi.org/10.1038/s41562-024-02077-2

- Kosmyna, N. et al. (2025). Your Brain on ChatGPT: Accumulation of Cognitive Debt when Using an AI Assistant for Essay Writing Task. arXiv:2506.08872. MIT Media Lab. arxiv.org/abs/2506.08872